Nel 2002 il compositore scandinavo Leif Inge ha realizzato digitalmente una espansione temporale della Nona Sinfonia di Beethoven portandola alla durata di 24 ore, senza distorsioni o variazioni di altezza. Considerando che la durata normale della Nona si aggira intorno ai 67 minuti (ma dipende dal direttore: può anche superare i 70′ e arrivare fino a 77’16” nella versione di Kubelik del ’74), si tratta di una espansione di circa 21.5 volte.

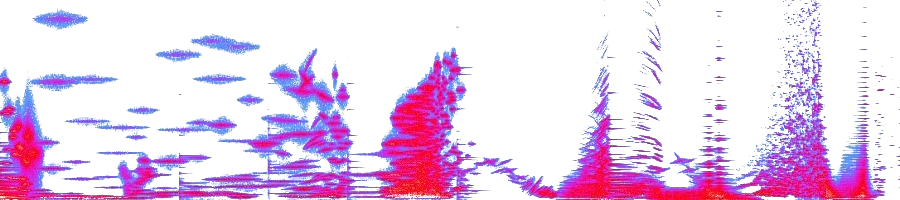

Il titolo del brano così ottenuto è 9 Beet Stretch e suona come un continuum sonoro in lenta evoluzione, ma non così lenta da non permettere di percepire cambiamenti in tempi ragionevoli (qualche minuto al massimo, ma generalmente in tempi più brevi). Ovviamente, con questi tempi, la melodia si perde completamente e il tutto si trasforma in una sequenza di accordi, ma è interessante notare come il senso drammatico dell’armonia in gran parte rimanga.

Gli attacchi delle note sono tutti molto graduali perché non si tratta di una esecuzione rallentata, ma di uno stretching del segnale audio, quindi un attacco che in originale dura 1/10 di secondo, nella versione espansa dura 2.15 secondi. La versione utilizzata è una registrazione Naxos diretta da Béla Drahos con la Nicolaus Esterházy Sinfonia e Coro (Naxos 8.553478).

Lo stream si può ascoltare via internet dal sito di riferimento avviando il player. La trasmissione inizia all’ora in cui il sole tramonta a Vienna il 26 Marzo (le 18:16 CET), giorno e ora della morte di Beethoven, e continua 24/7. Di conseguenza, nelle giornate di ora solare, i quattro movimenti hanno i seguenti tempi di inizio (CET = central europe time, cioè il nostro fuso orario)

- CET 18:16 movement 1 – duration 5½ hours

- CET 23:43 movement 2 – duration 5 hours

- CET 04:48 movement 3 – duration 5 hours

- CET 09:24 movement 4 – duration 8½ hours

Nel periodo di ora legale, dovete aggiungere un’ora.